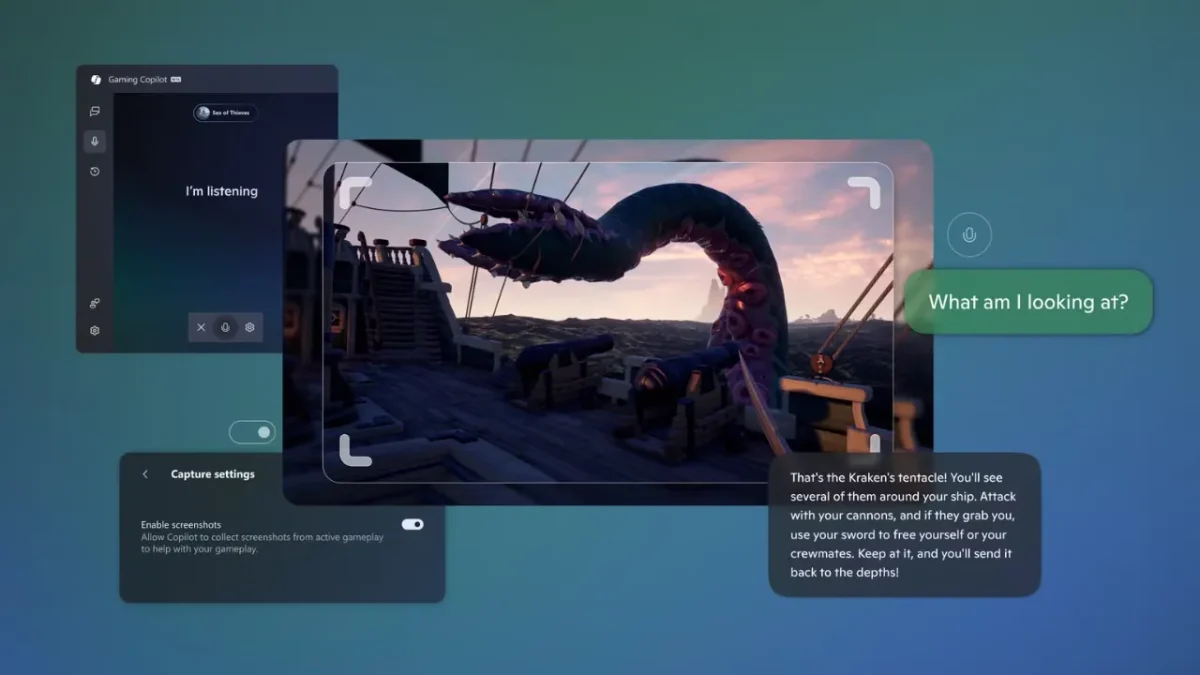

A inteligência artificial está a chegar a todo o lado, e o mundo dos videojogos não é exceção. A Microsoft integrou recentemente o seu assistente Copilot na Barra de Jogo do Xbox (Xbox Game Bar) no Windows, prometendo uma ajuda inteligente enquanto jogas. No entanto, o que deveria ser uma ferramenta útil rapidamente se tornou no centro de uma nova e assustadora polémica sobre privacidade. Um relato online viralizou com uma acusação grave: o Copilot estaria a gravar secretamente tudo o que fazes nos teus jogos para treinar os modelos de IA da Microsoft.

A ideia de teres a Microsoft a observar cada movimento teu, mesmo em jogos ainda não lançados e protegidos por acordos de confidencialidade (NDAs), é, compreensivelmente, arrepiante. Perante a tempestade de críticas que se formou, a gigante tecnológica veio a público fazer um desmentido categórico. Mas será que podemos confiar na sua palavra?

A origem do pânico: o relato que incendiou os fóruns

Tudo começou num tópico no popular fórum de videojogos ResetEra. Um utilizador partilhou uma experiência alarmante. Após a instalação automática do novo Copilot na Game Bar, reparou num tráfego de rede suspeito. Segundo ele, a ferramenta estava a “enviar automaticamente tudo o que [ele] estava a fazer para a Microsoft (incluindo um jogo sob NDA que [ele] estava a jogar)“.

A sua investigação levou-o às definições da ferramenta, onde descobriu que, por defeito, estava ativa uma opção para “treinar com o texto visto no ecrã”. A sua conclusão foi explosiva: o Copilot estaria a fazer capturas de ecrã constantes, a extrair o texto dessas imagens através de OCR (Reconhecimento Ótico de Caracteres) e a enviar tudo para a Microsoft para treinar os seus modelos de IA. A acusação não podia ser mais grave: espionagem em tempo real disfarçada de assistente de jogo.

A resposta da Microsoft: “Não estamos a fazer isso!”

Confrontada com uma potencial crise de relações públicas, a Microsoft não demorou a reagir. Num comunicado enviado ao site Tom’s Hardware, a empresa negou veementemente as acusações. A mensagem central é clara: o Copilot não recolhe dados da tua jogabilidade em segundo plano sem a tua permissão explícita.

Como é que o Copilot funciona (segundo a Microsoft)?

A empresa esclareceu o funcionamento da ferramenta, tentando dissipar os receios:

- Capturas de ecrã só com a tua ação: O Copilot só tira uma captura de ecrã do teu jogo quando tu, ativamente, decides usar a funcionalidade e lhe envias manualmente essa imagem para pedir ajuda ou informação. Não há qualquer captura automática ou secreta a acontecer em segundo plano.

- Imagens partilhadas NÃO são usadas para treino: E aqui reside o ponto mais crucial do desmentido. Mesmo as capturas de ecrã que tu decides partilhar com o Copilot não são usadas para treinar os modelos de IA da Microsoft. A empresa afirma que estas imagens são processadas apenas para te dar a resposta que pediste e depois descartadas (ou geridas de acordo com as tuas definições de privacidade gerais da conta Microsoft).

O que PODE ser usado para treino (com o teu consentimento)?

Então, o que é que a Microsoft pode usar para treinar a IA? A resposta está nas tuas conversas de texto ou voz com o próprio Copilot. Tal como acontece com outros chatbots, as tuas interações diretas com o assistente podem ser usadas para melhorar o serviço. No entanto, e este é um ponto fundamental, a Microsoft sublinha que tens controlo sobre esta partilha. Podes aceder às definições de privacidade da Xbox Game Bar e escolher se permites ou não que as tuas conversas sejam usadas para este fim.

Confiar ou desconfiar? O dilema da era da IA

Chegamos então ao cerne da questão: em quem acreditar? No relato detalhado do utilizador no ResetEra ou no desmentido oficial da Microsoft?

Neste momento, sem provas concretas que contrariem a versão da empresa, a posição mais razoável é dar o benefício da dúvida à Microsoft. Acusar uma empresa desta magnitude de uma prática tão invasiva e potencialmente ilegal exige mais do que um relato isolado, por muito detalhado que seja.

No entanto, a desconfiança é compreensível. Vivemos numa era em que a recolha massiva de dados se tornou a norma, e a transparência sobre o que acontece com essa informação é, muitas vezes, escassa. As empresas de IA, em particular, têm uma “fome” insaciável por dados para treinar os seus modelos, o que alimenta o receio de que possam estar a ultrapassar os limites éticos e legais para os obter.

Para a Microsoft, a aposta é altíssima. Se, no futuro, surgirem provas de que a empresa mentiu neste caso, o dano para a sua reputação e para a confiança do público nas suas ferramentas de IA seria catastrófico e, muito provavelmente, irreparável. Numa altura em que a Microsoft está a integrar o Copilot em todos os cantos do seu ecossistema, desde o Windows aos jogos, a transparência e a honestidade sobre a utilização de dados não são apenas uma questão ética; são uma necessidade de negócio.

Por agora, resta-nos vigiar de perto, verificar as nossas definições de privacidade e esperar que a Microsoft esteja, de facto, a ser sincera. O futuro da nossa relação com a inteligência artificial depende dessa confiança.

Outros artigos interessantes: