Perceber a diferença entre um chatbot e um agente de IA é essencial para compreender por que razão esta tecnologia representa simultaneamente uma revolução de produtividade e um novo vetor de risco em cibersegurança.

Durante anos, a inteligência artificial resumiu-se a uma lógica simples – o utilizador escreve, a máquina responde. Os chatbots como o ChatGPT, na sua forma mais básica, seguem exatamente este modelo – são ferramentas reativas, confinadas ao texto e dependentes de cada novo estímulo humano para avançar. Os agentes de IA rompem com esta lógica por completo.

O que distingue um agente de IA de um chatbot

Um chatbot tradicional opera dentro de um ciclo fechado, recebe uma pergunta e devolve uma resposta, sem memória persistente, sem capacidade de ação no mundo real e sem iniciativa própria. Um agente de IA, por outro lado, recebe um objetivo de alto nível, divide-o em múltiplos passos, executa-os de forma sequencial e adapta o plano em função dos resultados intermédios, tudo sem intervenção humana contínua.

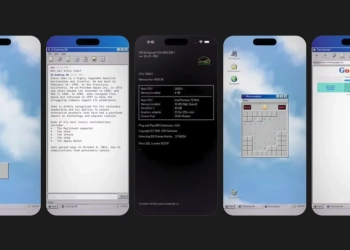

A distinção prática é clara. Se pedir a um chatbot para reservar um jantar, ele descreve como o fazer. Se pedir a um agente de IA, ele abre o browser, pesquisa restaurantes disponíveis, compara horários, preenche o formulário e confirma a reserva. É a diferença entre obter informação e obter um resultado.

Autonomia como fator central

O elemento que define os agentes de IA é a autonomia, ou seja, a capacidade de tomar decisões sem aguardar aprovação a cada passo. Para o conseguir, estes sistemas combinam três componentes fundamentais – memória contextual para manter o estado da tarefa ao longo do tempo, um módulo de planeamento para decompor objetivos complexos, e acesso a ferramentas externas como browsers, APIs, bases de dados e sistemas de ficheiros.

Em 2026, esta arquitetura já é uma realidade operacional em setores como a saúde, as finanças e o apoio ao cliente. Empresas como a Salesforce comercializam plataformas de agentes autónomos capazes de gerir fluxos de trabalho inteiros, resolver pedidos de suporte e executar transações sem qualquer interação humana.

A autonomia que cria vulnerabilidade

É precisamente esta capacidade de agir no mundo real que torna os agentes de IA um alvo atrativo para atacantes. Um chatbot comprometido pode devolver uma resposta incorreta – um erro contido, sem consequências físicas. Um agente comprometido pode transferir fundos, exfiltrar dados ou instanciar novos agentes maliciosos dentro de um fluxo de trabalho confiável.

Foi esta realidade que levou investigadores do Google DeepMind a publicar, em março de 2026, um estudo que classifica seis tipos de armadilhas adversariais concebidas especificamente para sequestrar agentes de inteligência artificial que navegam na web de forma autónoma

Outros artigos interessantes: