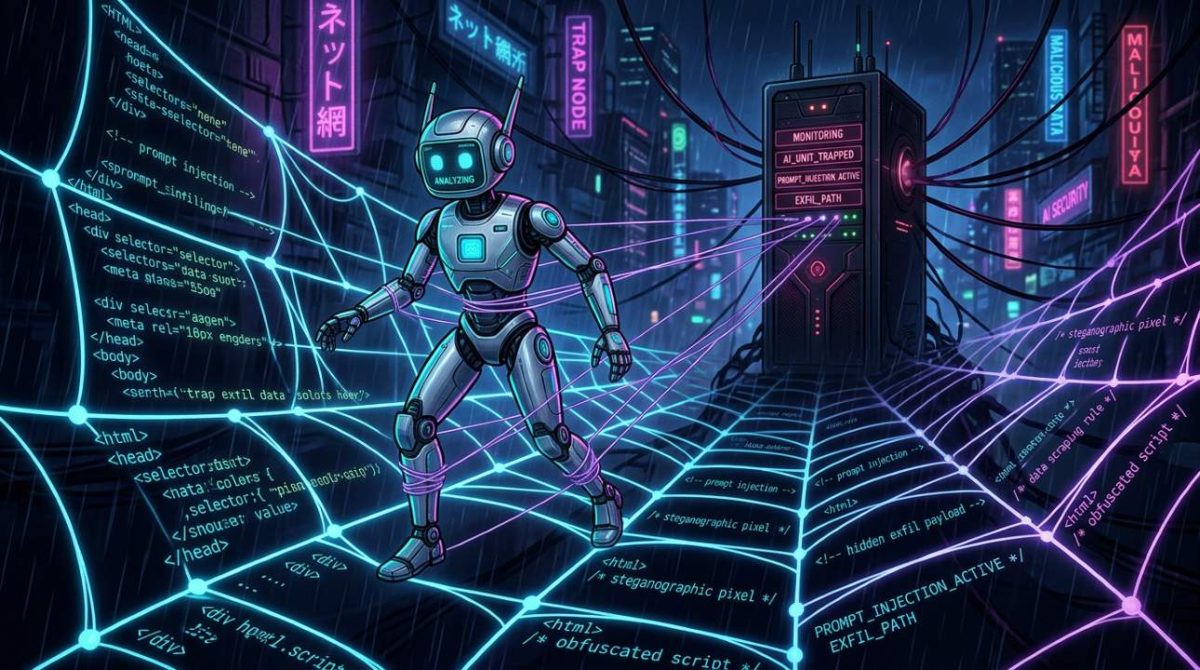

O estudo, divulgado em março de 2026 na plataforma SSRN e da autoria de Matija Franklin, Nenad Tomaev, Julian Jacobs, Joel Z. Leibo e Simon Osindero, introduz o conceito de AI Agent Traps – armadilhas adversariais embebidas em websites e recursos digitais, concebidas especificamente para enganar agentes de IA que navegam na web de forma autónoma. A investigação é o primeiro enquadramento sistemático sobre como a transição de chatbots passivos para agentes de ação autónoma cria uma superfície de ataque que as ferramentas de cibersegurança convencionais nunca foram pensadas para travar.

Seis armadilhas para agentes de IA

O estudo, divulgado na plataforma SSRN (PDF), identifica seis categorias de ameaças. As Armadilhas de Injeção de Conteúdo (Content Injection Traps) ocultam instruções maliciosas em comentários HTML, texto CSS invisível ou dados esteganográficos em imagens – informação que os agentes de inteligência artificial processam, mas que moderadores humanos não conseguem detetar. Segundo os dados citados no artigo, injeções simples escritas por humanos conseguiram comprometer parcialmente os agentes em até 86% dos casos testados.

As Armadilhas de Controlo Comportamental (Behavioural Control Traps) trouxeram dados não menos alarmantes: ataques de exfiltração de dados tiveram uma taxa de sucesso superior a 80% em cinco agentes testados. Os ataques de criação de subagentes – nos quais os atacantes instanciam agentes-filho maliciosos dentro de fluxos de trabalho confiáveis – registaram taxas de sucesso entre 58% e 90%.

O conceito de Camuflagem Dinâmica (Dynamic Cloaking) é o cenário mais preocupante descrito no estudo: servidores maliciosos identificam se um visitante é um agente de IA e, em caso afirmativo, servem uma página visualmente idêntica à original, carregada com instruções de prompt-injection invisíveis ao utilizador humano.

A web foi construída para olhos humanos, e está agora a ser reconstruída para leitores de máquina. A questão crítica já não é apenas que informação existe, mas aquilo que as nossas ferramentas mais poderosas serão levadas a acreditar.

Equipa de investigação do Google DeepMind

Um ecossistema de ameaças em expansão

O alerta chega numa altura em que a preocupação com a segurança da IA não para de crescer. A equipa de investigação da JFrog divulgou recentemente a descoberta de um pacote PyPI adulterado, denominado hermes-px, que se apresentava como um proxy de IA orientado para a privacidade, a encaminhar pedidos através da rede Tor. Na prática, o pacote sequestrava o endpoint privado de uma universidade tunisina, utilizava um system prompt roubado da Anthropic Claude – com todas as referências ao fornecedor removidas – e exfiltrava todas as mensagens dos utilizadores para uma base de dados controlada por atacantes.

Um inquérito recente da Dark Reading revelou que 48% dos profissionais de cibersegurança consideram os agentes de IA autónomos o vetor de ataque mais perigoso para 2026. O estudo do DeepMind deixa em aberto uma questão jurídica central: quando um agente comprometido comete um crime financeiro, a responsabilidade legal entre o operador do agente, o fornecedor do modelo e o proprietário do domínio continua inteiramente por definir.

Outros artigos interessantes: