Muitos de nós já usámos a Inteligência Artificial para tarefas banais, como escrever um e-mail chato para o trabalho ou planear um roteiro de férias. Mas a verdade é que, à medida que estes modelos se tornam mais conversacionais e empáticos, milhões de pessoas começaram a utilizar o ChatGPT para conversas profundamente pessoais e íntimas. É um espaço onde podes desabafar sobre medos, ansiedades e problemas que talvez nunca tivesses a coragem de partilhar com amigos ou familiares. A OpenAI tem plena consciência desta realidade e acaba de lançar uma funcionalidade global que promete criar uma ponte vital entre o teu refúgio digital e as pessoas que realmente se importam contigo na vida real.

A nova ferramenta, batizada de ChatGPT Trusted Contact (Contacto de Confiança), foi desenhada especificamente para atuar como uma rede de segurança silenciosa. Se o sistema detetar que podes estar em risco de causar danos a ti próprio, ele vai pedir ajuda por ti.

Como funciona o novo contacto de segurança

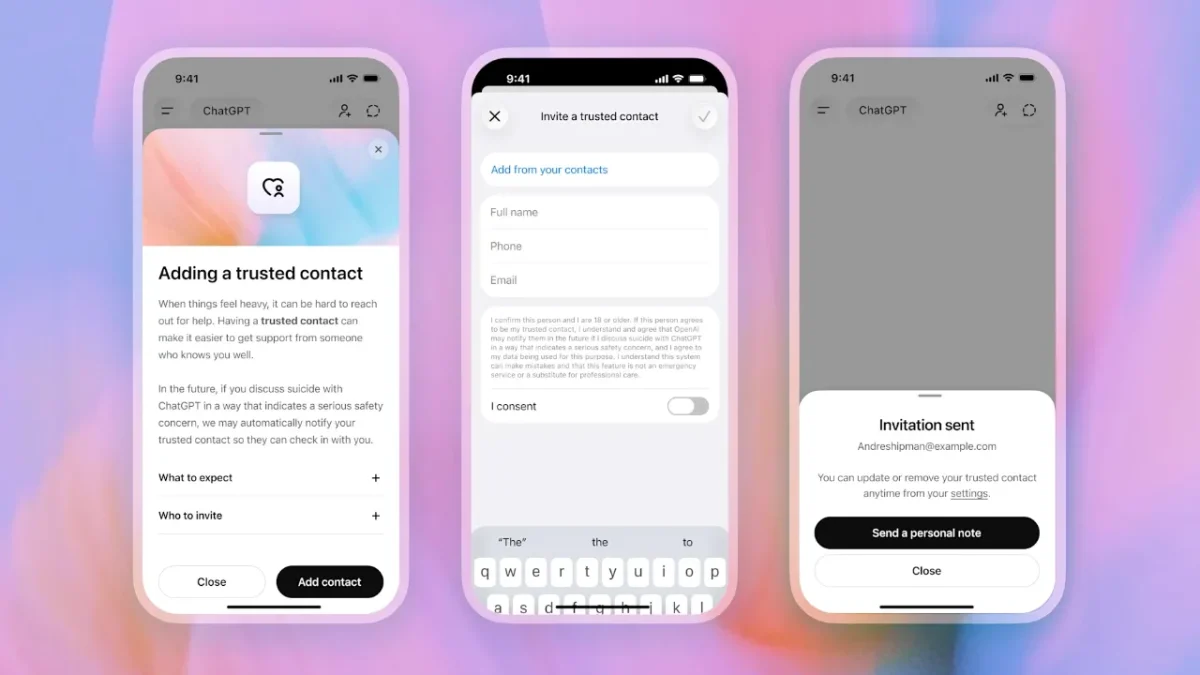

A mecânica desta nova funcionalidade é bastante inteligente e foi construída com um enorme foco no respeito pela tua privacidade. Para começares, tens de ir às definições da tua conta pessoal do ChatGPT e convidar ativamente uma pessoa da tua inteira confiança — pode ser um familiar, o teu melhor amigo ou até um cuidador profissional. Esse teu contacto terá exatamente uma semana para aceitar o convite através do sistema.

A partir do momento em que a ligação está estabelecida, a Inteligência Artificial passa a estar atenta a sinais de alerta. Se os sistemas automatizados do ChatGPT detetarem uma conversa que indique um risco sério de automutilação ou suicídio, o caso é imediatamente reencaminhado para uma pequena equipa de revisores humanos altamente treinados. A OpenAI promete que esta avaliação humana será concluída em menos de uma hora.

Se os especialistas confirmarem que existe um risco genuíno para a tua segurança, o teu contacto de confiança recebe imediatamente um alerta discreto (por e-mail, mensagem de texto ou notificação na app). A mensagem apenas informa a pessoa de que surgiu uma preocupação de segurança e encoraja-a a entrar em contacto contigo para saber se está tudo bem. O grande detalhe aqui é a privacidade: a OpenAI nunca partilha os teus registos de conversa, nem o conteúdo do que escreveste, com o teu contacto. O segredo da tua conversa com a máquina mantém-se intacto.

A pressão para resolver falhas do passado

A decisão de criar esta rede de segurança não surgiu por acaso. A OpenAI tem estado sob uma pressão pública e mediática brutal para melhorar a forma como lida com situações de crise de saúde mental. No ano passado, um relatório muito duro da BBC expôs casos concretos onde o chatbot acabou por dar respostas prejudiciais e perigosas em conversas sensíveis. A própria empresa já tinha admitido que as suas barreiras de segurança (guardrails) tendiam a degradar-se ou a falhar quando as conversas se tornavam demasiado longas e profundas.

Para não cometer erros num tema tão delicado, a OpenAI não trabalhou sozinha. A funcionalidade foi desenvolvida em colaboração direta com a Associação Americana de Psicologia (APA) e com o próprio Conselho de Especialistas em Bem-Estar e IA da empresa. Os dados internos justificam plenamente a urgência desta medida: a marca revelou que cerca de 0,15% dos seus utilizadores ativos semanais têm conversas que envolvem indicadores explícitos de potencial automutilação. Num universo de centenas de milhões de utilizadores, estamos a falar de um número assustadoramente grande de pessoas a precisar de apoio.

O grande dilema entre a ajuda e a privacidade

Como é óbvio, este sistema está longe de ser absolutamente perfeito e a própria OpenAI é a primeira a admitir isso. Existe aqui um enorme dilema ético e prático. Uma das grandes razões pelas quais as pessoas procuram a Inteligência Artificial para desabafar é precisamente o facto de ela não ser humana. A IA não julga, não sente pena e, acima de tudo, não vai contar a ninguém. Saber que um alerta pode ser acionado para a família pode acabar por afastar os utilizadores mais vulneráveis que procuram apenas um espaço de total anonimato.

É exatamente por isso que a ferramenta é totalmente opcional (opt-in), limitada a um único contacto adulto por conta, e está restrita apenas às contas pessoais (deixando de fora os planos de empresas ou de educação). Se sentes que ter alguém de sobreaviso te traz paz de espírito, a opção agora existe e está à distância de um clique. Com a nossa vida emocional a cruzar-se cada vez mais com servidores e algoritmos, criar mecanismos que nos liguem de volta à humanidade quando mais precisamos é um passo tecnológico e social que já vinha tarde.

Outros artigos interessantes: