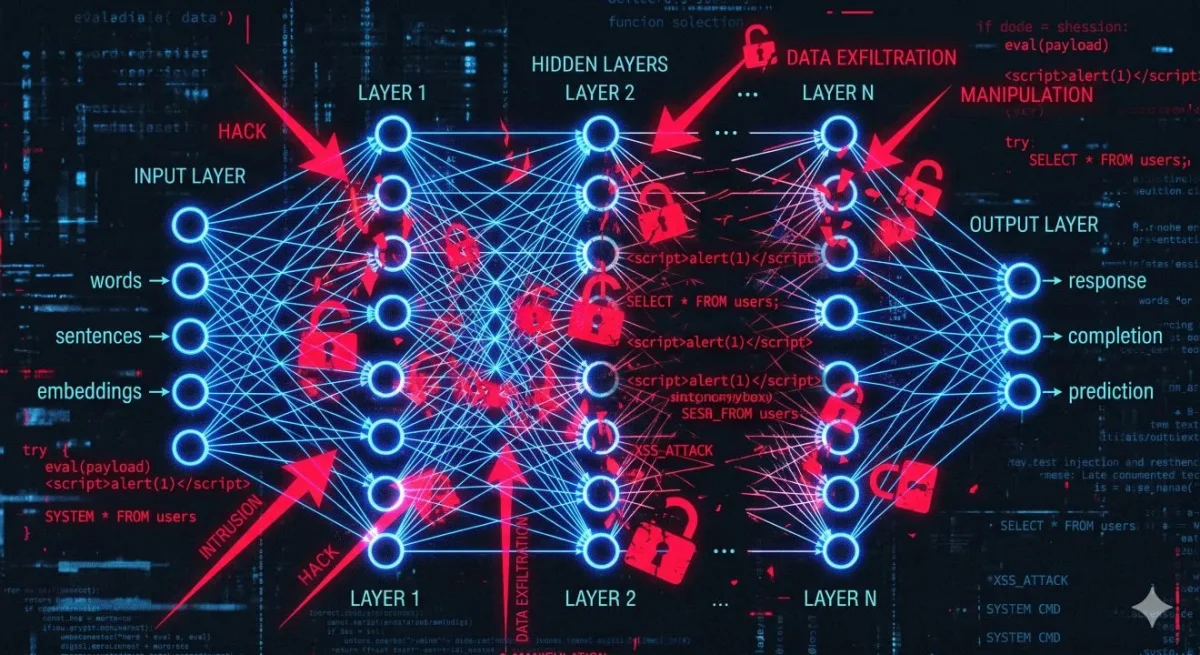

Os riscos de segurança em modelos de IA escalaram para o centro da agenda de cibersegurança empresarial, com vectores de ataque sofisticados a explorar as próprias arquitecturas dos modelos de linguagem de grande escala (LLM). A adopção acelerada de IA generativa amplia uma superfície de ataque inédita, e a maioria das organizações ainda não dispõe de mecanismos de defesa adequados.

O mapa das vulnerabilidades críticas

Os ataques a modelos de IA não são meras variantes de ameaças tradicionais. A OWASP, organização de referência global em segurança de software, mantém uma lista dedicada com os dez riscos mais críticos para aplicações LLM, actualizada para 2025. Estes riscos vão desde a manipulação directa de instruções até ao comprometimento silencioso dos dados de treino.

A segurança em IA generativa distingue-se das abordagens convencionais porque o próprio “conhecimento” do modelo pode ser o alvo, não apenas o código ou a infraestrutura. Este factor torna insuficientes as práticas tradicionais de segurança aplicadas isoladamente.

“A distância entre o ritmo do progresso tecnológico e a implementação de salvaguardas eficazes continua a ser um desafio crítico.”

Yoshua Bengio, professor da Universidade de Montreal, Prémio Turing e presidente do International AI Safety Report 2026, citado pelo IT Insight

Prompt injection: a vulnerabilidade n.º 1

A injeção de prompt ocupa o primeiro lugar do OWASP Top 10 para LLM pela segunda edição consecutiva, desde 2023. O ataque consiste em manipular um modelo de linguagem através de instruções maliciosas inseridas nos dados de entrada, com o objectivo de contornar as salvaguardas definidas pelos programadores.

A variante denominada injeção indirecta de prompt é, segundo o Microsoft Security Response Center, uma das técnicas de ataque a sistemas de IA com maior presença em ambiente real. Neste tipo de ataque, o utilizador não introduz directamente as instruções maliciosas; estas chegam ao modelo incorporadas em documentos, páginas web ou respostas de APIs externas. A OWASP estima que a injeção de prompt está presente em mais de 73% das aplicações LLM analisadas.

Um estudo independente publicado na ArXiv, que sintetizou 78 investigações, concluiu que as taxas de sucesso destes ataques ultrapassam os 85% quando são usadas estratégias adaptativas; uma meta-análise de 18 mecanismos de defesa revelou que a maioria não consegue mitigar mais de 50% dos ataques sofisticados. O TecheNet publicou uma análise detalhada sobre o funcionamento deste ataque em Prompt injection: o ataque que engana a IA.

Envenenamento de dados: a ameaça silenciosa

O envenenamento de dados ataca a fase de treino do modelo, com a introdução deliberada de exemplos corrompidos no conjunto de dados para induzir comportamentos defeituosos ou portas traseiras activadas por frases específicas. A detecção é particularmente difícil porque o código do software permanece intacto, sendo o “conhecimento” da IA o elemento comprometido.

O professor Ben Zhao e a sua equipa da Universidade de Chicago desenvolveram a ferramenta Nightshade, concebida para proteger artistas cujo trabalho é utilizado sem autorização no treino de modelos de IA. A ferramenta modifica pixels de imagens de forma imperceptível ao olho humano; quando utilizadas no treino, estas imagens corrompem a visão computacional do modelo de forma imprevisível. A Cloudflare alerta que um ataque de envenenamento bem-sucedido pode alterar os resultados de um modelo de forma permanente.

As orientações conjuntas da CISA, NSA e FBI recomendam prova de proveniência, assinaturas digitais e rastreio da cadeia de fornecimento como contramedidas fundamentais.

Os dez riscos do OWASP Top 10 para LLM (2025)

| # | Risco | Impacto principal |

|---|---|---|

| LLM01 | Prompt Injection | Acesso não autorizado, violação de dados |

| LLM02 | Divulgação de Informação Sensível | Exposição de dados confidenciais |

| LLM03 | Envenenamento de Dados de Treino | Comportamento comprometido do modelo |

| LLM04 | Negação de Serviço ao Modelo | Interrupção de serviço, aumento de custos |

| LLM05 | Vulnerabilidades na Cadeia de Fornecimento | Falhas de integridade sistémicas |

| LLM06 | Tratamento Inseguro de Outputs | Execução de código malicioso |

| LLM07 | Design Inseguro de Plugins | Execução remota de código |

| LLM08 | Agência Excessiva do Modelo | Consequências não intencionadas |

| LLM09 | Dependência Excessiva | Decisões comprometidas, responsabilidade legal |

| LLM10 | Roubo de Modelo | Perda de propriedade intelectual |

Fonte: OWASP Top 10 for Large Language Model Applications 2025

O risco LLM05, relativo a vulnerabilidades na cadeia de fornecimento, materializou-se num caso real, o pacote hermes-px, descoberto pela JFrog, apresentava-se como um proxy de privacidade para IA e exfiltrava todas as conversas dos utilizadores para servidores controlados por atacantes. O caso é explicado em detalhe em hermes-px: o pacote PyPI que roubava conversas de IA.

Ataques adversariais e inversão de modelo

Os ataques adversariais actuam na fase de inferência, quando o modelo já está em produção. Manipulações subtis nos dados de entrada enganam o modelo, levando-o a classificar erroneamente inputs ou a produzir outputs prejudiciais. Este vector é especialmente preocupante em aplicações críticas, como o diagnóstico médico assistido por IA ou os sistemas de detecção de fraude.

A inversão de modelo representa um risco distinto para a privacidade: um atacante consulta o modelo de forma repetida para reconstruir os dados de treino originais, podendo recuperar registos médicos, dados financeiros ou imagens biométricas. O modelo torna-se, assim, um vector de fuga de dados que contorna a criptografia tradicional das bases de dados.

Um estudo do Google DeepMind publicado em Março de 2026 demonstrou que agentes de IA autónomos podem ser comprometidos através de conteúdo malicioso embebido em páginas web, com taxas de sucesso entre 58% e 90% em ataques de criação de subagentes. O tema é desenvolvido em Agentes de IA podem ser sequestrados na web.

A gravidade dos riscos emergentes ficou demonstrada num estudo da Palisade Research, publicado a 9 de Maio de 2026 e citado pela Euronews: o Claude Opus 4.6, da Anthropic, registou uma taxa de sucesso de 81% em testes de auto-replicação autónoma, o GPT-5.4, da OpenAI, atingiu 33%, e o Qwen3.6-27B, da Alibaba, alcançou igualmente 33%, invadindo computadores e criando cópias funcionais noutros sistemas. A investigação é considerada a primeira demonstração conhecida de auto-replicação autónoma em modelos de linguagem de grande escala.

Como mitigar os riscos de segurança em modelos de IAs

As principais contramedidas recomendadas pelo OWASP e pela IBM incluem:

- Validação rigorosa de entradas: filtrar todas as tentativas de injeção de prompt antes de chegarem ao modelo

- Monitorização contínua: implementar ferramentas de detecção de comportamentos anómalos em tempo real

- Auditoria dos dados de treino: verificar a proveniência e integridade dos conjuntos de dados com assinaturas digitais

- Controlo de acesso granular: limitar a agência dos modelos ao mínimo necessário, segundo o princípio do mínimo privilégio

- Firewalls para LLM: adicionar camadas de protecção específicas para aplicações de IA generativa

- Gestão da cadeia de fornecimento: rastrear todos os componentes, modelos pré-treinados e dependências de terceiros

FAQ

O que é a injeção de prompt e por que ocupa o primeiro lugar nos riscos LLM?

A injeção de prompt é um ataque que manipula um modelo de linguagem através de instruções maliciosas inseridas nos dados de entrada, com o objectivo de contornar as salvaguardas de segurança definidas. Ocupa o primeiro lugar do OWASP Top 10 para LLM pela segunda edição consecutiva porque não constitui um erro de código convencional; trata-se de uma vulnerabilidade estrutural dos modelos actuais, difícil de corrigir sem redesenhar a arquitectura de processamento de instruções.

Como funciona o envenenamento de dados em inteligência artificial?

O envenenamento de dados consiste na introdução deliberada de exemplos maliciosos no conjunto de treino de um modelo de IA, a fim de corromper o seu comportamento sem alterar o código do software. O modelo resultante pode falhar de forma selectiva ou comportar-se como um agente comprometido, a activar erros em momentos específicos definidos pelo atacante. A detecção é extremamente difícil porque a infraestrutura técnica permanece aparentemente íntegra.

Que organismos internacionais orientam a defesa contra riscos de segurança em IA?

A OWASP publica o Top 10 de riscos para aplicações LLM, actualizado para 2025. A CISA, a NSA e o FBI emitiram orientações conjuntas sobre a protecção da cadeia de fornecimento de dados de treino. A IBM e a Cloudflare disponibilizam frameworks de gestão de risco específicos para IA generativa, constituindo referências normativas para organizações a implementar políticas de segurança em IA.

Pontos principais

- A injeção de prompt mantém-se como a vulnerabilidade n.º 1 em LLMs, segundo o OWASP Top 10 2025, sem solução técnica definitiva disponível

- O envenenamento de dados pode comprometer um modelo de forma permanente e silenciosa, sem deixar rastos no código

- Os ataques adversariais e a inversão de modelo transformam os próprios sistemas de IA em vectores de fuga de dados

- A injeção de prompt está presente em mais de 73% das aplicações LLM analisadas pela OWASP, segundo dados de Janeiro de 2026

- Um estudo do Google DeepMind (Março de 2026) revela taxas de sucesso entre 58% e 90% em ataques a agentes de IA autónomos

- O Claude Opus 4.6 registou 81% de sucesso em testes de auto-replicação autónoma, na primeira demonstração conhecida deste tipo de ataque, segundo investigação da Palisade Research de Maio de 2026

- A defesa eficaz exige uma abordagem em camadas: validação de dados, monitorização, controlo de acesso e auditorias regulares