A destilação de modelos de IA é um processo técnico que permite a um sistema de inteligência artificial mais pequeno aprender a replicar o comportamento de um modelo muito maior, a uma fração do custo computacional. O conceito remonta a 2006, quando Buciluǎ, Caruana e Niculescu-Mizil o formalizaram no artigo Model Compression, publicado na conferência KDD. Em 2015, Geoffrey Hinton e colaboradores da Google publicaram o artigo seminal Distilling the Knowledge in a Neural Network, que popularizou a técnica no domínio das redes neurais profundas. A mesma técnica tornou-se o centro de um alerta diplomático global emitido pelo Departamento de Estado dos EUA, com implicações geopolíticas que transcendem o setor tecnológico.

A metáfora que explica o processo

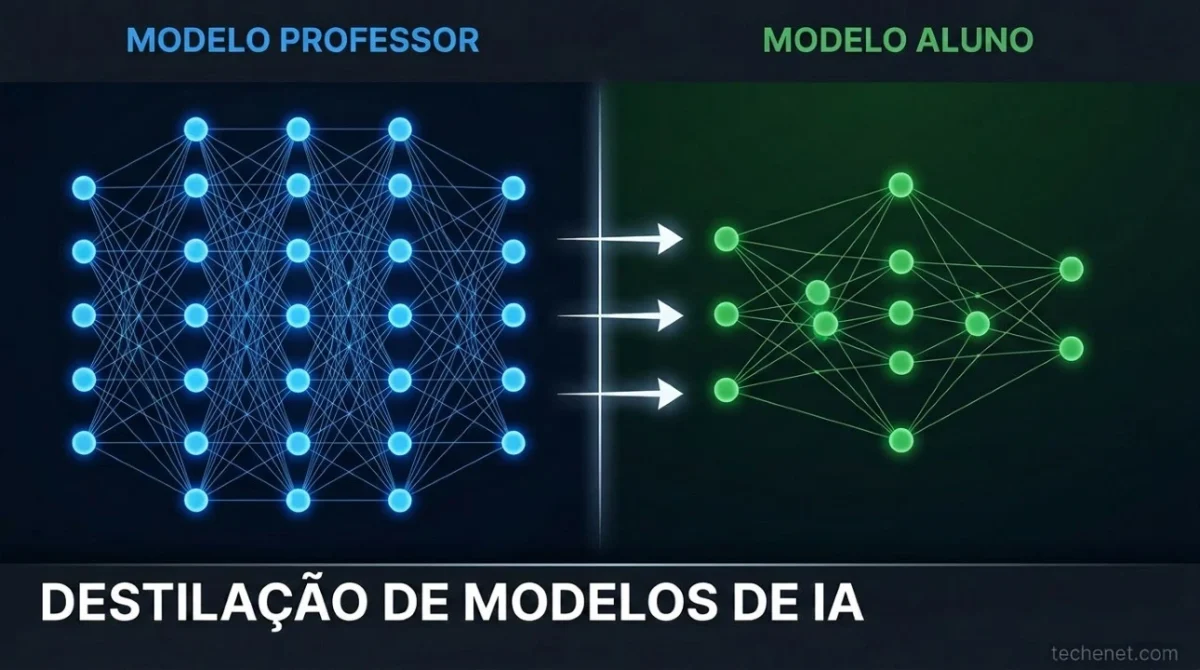

Imagine um médico especialista com décadas de experiência clínica. Transferir esse conhecimento para um estudante de medicina não exige que o estudante repita todos os anos de formação do especialista: basta que o especialista explique os seus raciocínios, as suas dúvidas e os seus padrões de decisão. A destilação de modelos de IA funciona de forma análoga. O modelo professor, que pode ter centenas de milhares de milhões de parâmetros e custar dezenas de milhões de dólares a treinar, gera respostas detalhadas a um conjunto de dados. O modelo aluno, muito mais pequeno, aprende não apenas as respostas corretas, mas os padrões de raciocínio subjacentes do professor.

No treino convencional, um modelo aprende apenas se uma resposta está certa ou errada. Um modelo aluno aprende com a distribuição de probabilidades do modelo professor, o que a IBM descreve como “rótulos suaves” (soft labels). Em vez de aprender unicamente que “Paris é a capital de França”, aprende que Paris é muito provável, Lyon é pouco provável, e Berlim é ainda menos provável. Esta informação adicional acelera e enriquece o processo de aprendizagem do modelo aluno.

Como funciona a destilação de modelos de IA tecnicamente

O processo divide-se, em termos gerais, em três fases, segundo a DS Academy e a Thoughtworks:

- Geração de dados pelo modelo professor. O modelo maior processa um conjunto de entradas e gera as suas respostas, incluindo as distribuições de probabilidade sobre todas as respostas possíveis. Estes dados tornam-se o conjunto de treino do modelo aluno.

- Treino do modelo aluno. O modelo mais pequeno é treinado para minimizar a diferença entre as suas próprias distribuições de probabilidade e as do professor. Esta diferença é calculada com recurso a uma função matemática chamada divergência KL (Kullback-Leibler), que mede a distância entre duas distribuições de probabilidade.

- Ajuste fino e avaliação. O modelo aluno é refinado e avaliado em tarefas específicas para confirmar que retém as capacidades mais relevantes do professor.

Tecnicamente, o processo recorre a ferramentas como o PyTorch, o TensorFlow ou o Intel Neural Compressor, onde um ciclo de treino personalizado calcula em simultâneo a perda entre as saídas do aluno e do professor, de acordo com a DS Academy.

Os diferentes tipos de destilação

Não existe uma única forma de destilação de modelos de IA. A literatura técnica identifica três variantes principais, com aplicações distintas:

- Destilação de respostas: O modelo aluno aprende apenas com as saídas finais do professor. É o método mais simples e o mais comum em aplicações comerciais.

- Destilação de características: O aluno aprende com as representações intermédias do professor, ao captar padrões mais profundos e detalhados. Exige maior capacidade computacional.

- Destilação em camadas: Transferência de conhecimento a partir de camadas específicas do modelo professor, útil para tarefas muito especializadas.

Segundo a Thoughtworks, a destilação pode ser combinada com técnicas de quantização e poda (pruning) para otimização adicional, ao reduzir ainda mais o tamanho do modelo aluno sem perda significativa de precisão.

As vantagens práticas

A OpenAI, a Google e a Meta utilizam a destilação de LLM de forma sistemática por razões objetivas. Os benefícios são concretos e mensuráveis, segundo a IBM:

- Custo reduzido: Modelos menores custam menos a operar. A diferença pode atingir uma ou duas ordens de grandeza no custo por token.

- Velocidade de inferência: Um modelo aluno processa pedidos mais rapidamente, um fator crítico em aplicações de tempo real.

- Acessibilidade: Um modelo destilado pode correr em hardware comum, incluindo laptops e telemóveis, sem acesso a centros de dados com GPUs dedicadas.

- Especialização eficiente: Em vez de treinar um modelo de raiz para uma tarefa específica, uma empresa pode destilar apenas as capacidades relevantes de um modelo generalista.

A eficiência em inteligência artificial tornou-se, por esta via, um objetivo alcançável por organizações sem os recursos das grandes empresas tecnológicas.

Os limites que raramente são mencionados

A destilação de modelos de IA não é uma solução sem custos. O modelo aluno herda não apenas as capacidades do professor, mas também os seus enviesamentos, erros sistemáticos e limitações editoriais. Se o modelo professor tiver tendência para produzir respostas incorretas em determinadas categorias de perguntas, o aluno replicará esse padrão, por vezes de forma amplificada.

Existe também uma perda inevitável de precisão, especialmente em tarefas que exigem raciocínio em múltiplos passos. Segundo a Thoughtworks, a destilação “busca preservar o conhecimento específico do domínio, minimizando a perda de precisão”, mas este objetivo tem limites práticos. Um modelo aluno com sete mil milhões de parâmetros não replica com fidelidade total um modelo com um bilião.

Por fim, a compressão de modelos de linguagem por via da destilação levanta questões de propriedade intelectual que os sistemas jurídicos existentes ainda não conseguem resolver. Quando um modelo aluno aprende com as saídas de um modelo proprietário, transfere valor criado pelo detentor dos direitos sobre esse modelo, sem necessariamente compensá-lo. É precisamente esta questão que está no centro da disputa geopolítica entre Washington e Pequim.

Da técnica legítima à acusação de espionagem tecnológica

A destilação de modelos de IA é, por si só, uma técnica legítima e amplamente utilizada pela indústria. A Anthropic reconheceu-o explicitamente: a destilação é uma prática “legítima” quando os próprios laboratórios destilam os seus modelos para “criar versões mais pequenas e baratas para os seus clientes”. O problema identificado pelas autoridades americanas não é a técnica em si, mas a sua utilização não autorizada: criar contas falsas em plataformas como o ChatGPT ou o Claude, gerar milhões de interações e usar essas respostas para treinar modelos concorrentes, em violação dos termos de serviço.

A Anthropic identificou cerca de 24.000 contas fraudulentas associadas a três empresas chinesas, com volumes muito distintos: a MiniMax gerou mais de 13 milhões de interações com o Claude, a Moonshot AI 3,4 milhões, e o DeepSeek cerca de 150.000, segundo o TugaTech. A OpenAI alertou o Congresso americano para o uso de contas proxy ofuscadas para extrair respostas do ChatGPT em escala.

A destilação no DeepSeek tornou-se o caso mais mediático deste debate. A startup de Hangzhou utilizou a destilação de forma extensiva no desenvolvimento dos seus modelos, incluindo o DeepSeek R1 e, mais recentemente, o V4-Pro, com 1,6 biliões de parâmetros totais, publicado sob licença MIT de código aberto. O Departamento de Estado dos EUA enviou, a 25 de abril de 2026, um telegrama diplomático a postos consulares em todo o mundo a alertar para estas práticas, e o Congresso debate o Deterring American AI Model Theft Act (H.R. 8283), que propõe sanções para entidades que realizem extração não autorizada em escala industrial.

O debate que Washington não antecipou

A resposta legislativa americana enfrenta uma objeção técnica que os seus proponentes não abordaram diretamente. Nathan Lambert, chefe da equipa de pós-treino do Allen Institute for AI (AI2), alertou que legislação anti-destilação nos EUA pode prejudicar as próprias startups americanas de código aberto e a investigação académica: uma proibição ampla poderia dificultar a inovação e concentrar o poder nos laboratórios de código fechado, segundo a Phemex. O debate transcende a dimensão técnica e a dimensão política. No fundo, coloca uma questão que os sistemas jurídicos existentes ainda não sabem responder: quando um modelo de IA aprende com as respostas de outro, quem detém o conhecimento resultante?

FAQ

O que é a destilação de modelos de IA?

A destilação de modelos de IA é uma técnica de aprendizagem automática que transfere o conhecimento de um modelo grande e poderoso, o modelo professor, para um modelo mais pequeno, o modelo aluno. O aluno aprende a replicar o comportamento do professor com base nas suas distribuições de probabilidade, ao reter as capacidades principais a um custo computacional muito inferior ao do treino de raiz, segundo a IBM.

Como se distingue a destilação autorizada da não autorizada?

A destilação não autorizada envolve a criação de contas fraudulentas para extrair sistematicamente respostas de modelos proprietários e usá-las para treinar modelos concorrentes, prática alegada pelo Departamento de Estado dos EUA contra empresas chinesas em abril de 2026, segundo o TugaTech.

Quais são os limites do modelo aluno face ao modelo professor?

O modelo aluno herda as capacidades do professor, mas também os seus enviesamentos e erros sistemáticos. Em tarefas de raciocínio complexo em múltiplos passos, a perda de precisão pode ser significativa. Segundo a Thoughtworks, a destilação preserva o conhecimento de domínio, mas um modelo de sete mil milhões de parâmetros não replica com fidelidade total um modelo com um bilião.

Outros artigos interessantes:

- Nvidia avisa: DeepSeek V4 com hardware Huawei ameaça o ocidente

- Como garantir a proteção de agentes de IA contra ataques

- Quem é responsável quando um agente de IA comete um crime?

Fontes

- IBM: O que é destilação de conhecimento?

- DS Academy: Destilação de Grandes Modelos de Linguagem

- Thoughtworks: Destilação de modelos — Technology Radar

- TugaTech: Anthropic acusa gigantes chinesas de roubar tecnologia através de contas falsas

- GovInfo: H.R. 8283 — Deterring American AI Model Theft Act of 2026

- Phemex: Investigador do AI2 alerta contra legislação anti-destilação nos EUA