A destilação de LLM está a reduzir as barreiras de acesso à inteligência artificial de alto desempenho, num setor historicamente dominado por grandes empresas tecnológicas. Treinar um modelo de linguagem de grande dimensão exige investimentos que variam entre dezenas e centenas de milhões de dólares, podendo ultrapassar os mil milhões nos modelos mais avançados, segundo o Stanford AI Index Report 2025. Para a maioria das organizações, esse acesso estava simplesmente fora de alcance.

A destilação de LLM está a mudar essa realidade de forma gradual e verificável. Para quem não está familiarizado com o conceito, recomendamos a leitura do artigo Destilação de modelos de IA: o que é e como funciona, onde explicamos os fundamentos desta técnica.

Por que razão a IA esteve fora do alcance da maioria

Os grandes modelos de linguagem, como o GPT-4 ou o Gemini Ultra, exigem infraestrutura de computação que poucos podem pagar. O custo técnico de treino do GPT-4 foi estimado entre 41 e 78 milhões de dólares, com o CEO da OpenAI, Sam Altman, a confirmar que o investimento total superou os 100 milhões de dólares. O Gemini Ultra 1.0 da Google atingiu 191 milhões de dólares apenas em custos de computação, segundo o Stanford AI Index Report 2025. Para uma startup, uma PME ou um investigador independente, esses valores são simplesmente inviáveis.

Além do custo financeiro, a latência e o consumo energético de modelos muito grandes limitam a sua aplicação em dispositivos com recursos reduzidos, como telemóveis, computadores pessoais ou sistemas embebidos. O resultado é uma concentração do poder da IA num número muito reduzido de organizações.

Como a destilação muda a equação

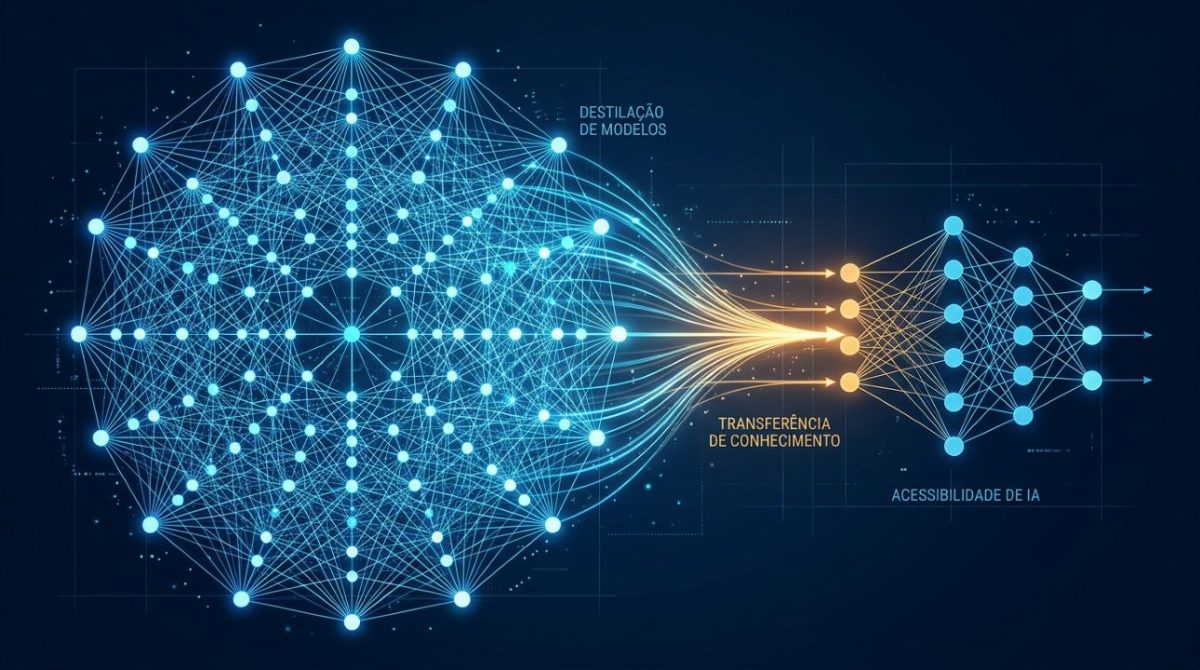

A destilação de LLM permite comprimir o conhecimento de um modelo grande, designado professor, para um modelo mais pequeno e eficiente, denominado aluno. O modelo aluno aprende não apenas com os dados de treino originais, mas com os padrões de raciocínio e as probabilidades geradas pelo modelo professor, o que resulta numa capacidade de generalização muito superior ao que seria possível treinar de raiz com os mesmos recursos. A distinção entre destilação e outras técnicas de otimização, como o fine-tuning, é igualmente relevante para compreender quando usar cada abordagem, tema que analisámos em profundidade no artigo Destilação de LLM vs fine-tuning: qual a diferença e quando usar cada técnica.

Na prática, modelos destilados atingem entre 95% e 97% do desempenho do modelo original, com custos de inferência de cinco a trinta vezes inferiores e velocidade de resposta até quatro vezes mais rápida. Investigadores independentes já conseguem treinar modelos competitivos por menos de 1.000 dólares, algo impensável há apenas três anos.

Quem beneficia concretamente

O acesso a modelos de IA de alto desempenho via destilação tem impacto direto em três grupos. As startups ganham acesso a modelos competitivos sem necessidade de renegociar contratos com fornecedores cloud de grande escala. As PMEs podem implementar soluções de IA personalizadas para os seus processos internos, sem depender de APIs externas com custos variáveis e imprevisíveis. Os investigadores e programadores individuais passam a ter acesso a modelos que correm em hardware de consumidor comum.

Este acesso mais amplo está a gerar uma nova dinâmica de desenvolvimento, onde a vantagem competitiva já não é determinada apenas pelo tamanho do orçamento de treino, mas pela qualidade da aplicação e da especialização.

Exemplos reais que provam o conceito

O DeepSeek-R1 é um dos casos mais citados de redução de custos via destilação. A empresa conseguiu transferir capacidades de raciocínio avançado para modelos mais pequenos, com o Qwen-32B destilado a superar o OpenAI o1-mini em vários benchmarks de referência, a uma fração do custo de operação.

O DistilBERT, desenvolvido pela Hugging Face, reduziu o modelo BERT original em 40%, mantendo 97% do desempenho em tarefas de compreensão de linguagem natural. Os modelos da família LLaMA e Mistral, amplamente utilizados pela comunidade open-source, tornaram-se referências de modelos eficientes que correm em hardware acessível, e aceleram o desenvolvimento de aplicações por programadores em todo o mundo.

Riscos e limites

A destilação não é uma solução universal. Modelos muito comprimidos podem perder capacidade em tarefas que exigem raciocínio complexo, longa memória de contexto ou domínios altamente especializados. A qualidade do modelo aluno depende diretamente da qualidade do modelo professor e dos dados de destilação utilizados, o que significa que erros, enviesamentos ou lacunas do modelo original são transferidos para o modelo mais pequeno.

Existe também um risco de concentração inversa: se apenas as grandes empresas têm acesso aos melhores modelos professores, o alcance desta técnica fica parcialmente limitado pela qualidade do ponto de partida. A sustentabilidade do ecossistema open-source, que alimenta grande parte deste processo, depende de financiamento e de incentivos que nem sempre estão garantidos a longo prazo.

Notas finais

A destilação de LLM não elimina as assimetrias do setor da inteligência artificial, mas reduz-as de modo substancial. Ao tornar modelos poderosos mais leves, mais baratos e mais acessíveis, esta técnica alarga o acesso a criadores, empresas e investigadores que, até há pouco tempo, não tinham participação ativa neste setor.

O alargamento do acesso à IA não é um destino, é um processo. E a destilação é, neste momento, um dos seus motores mais concretos.

Outros artigos interessantes:

- Nvidia avisa: DeepSeek V4 com hardware Huawei ameaça o ocidente

- Proibir ou integrar? O Piaget responde com formação em IA

- Gemini ganha novas ferramentas de saúde mental

FAQ

Por que razão os grandes modelos de IA são tão caros de treinar?

Porque exigem clusters de GPU de nível industrial, grandes volumes de dados e meses de computação intensiva. O treino do GPT-4, por exemplo, custou mais de 100 milhões de dólares no total, segundo o CEO da OpenAI, Sam Altman.

A destilação de LLM é suficiente para tornar a IA verdadeiramente acessível?

A destilação reduz significativamente os custos e os requisitos técnicos, mas não elimina todas as barreiras. A qualidade dos dados, o conhecimento técnico necessário e o acesso a modelos professores de referência continuam a ser fatores limitantes.

Qualquer empresa pode usar modelos destilados?

Sim. Modelos como o DistilBERT, LLaMA ou versões destiladas do Mistral já correm em hardware de consumidor e estão disponíveis gratuitamente através de plataformas como a Hugging Face.

A destilação compromete a segurança ou a ética dos modelos?

Eventualmente, sim. Enviesamentos e falhas do modelo professor são transferidos para o modelo aluno. Por isso, a avaliação ética e de segurança continua a ser obrigatória, mesmo em modelos mais pequenos.

Fontes

- Zylos Research – Model Distillation and Knowledge Transfer in AI 2026

- The Prompt Buddy – How Open-Source AI and Small Language Models Are Democratizing Technology in 2026

- Redis – Model Distillation for LLMs: Cut Costs & Boost Speed in 2026

- HTEC – AI Model Distillation Evolution and Strategic Imperatives in 2025

- Darrow AI – The Era of Distilled LLMs: Why Smaller Can Be Better

- ruh.ai – Small Language Models: The Efficient Future of AI in 2026

- Galileo AI – How Much Does LLM Training Cost?

- Zilliz – DistilBERT: A Smaller, Faster, and Distilled BERT

- Hugging Face / arXiv – DistilBERT paper original

- Stanford AI Index Report 2025 – via Forbes, TechRadar e Time Magazine